Desde que OpenAI presentó públicamente su chatbot de inteligencia artificial (IA) ChatGPT a finales de 2022, los avances en materia de IA no han parado, y continúan avanzando a una velocidad inquietante. Un ejemplo de esto es el último desarrollo de Microsoft, que acaba de revelar la nueva versión de su modelo de lenguaje pequeño (SML): Phi-2.

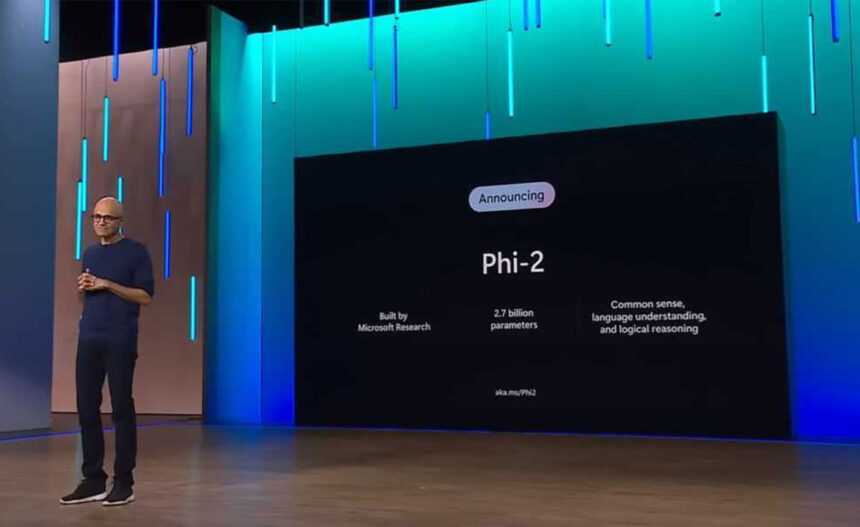

Microsoft Research, la rama de investigaciones del gigante de software, presentó el martes a Phi-2, un modelo de lenguaje con 2,7 mil millones de parámetros que, a pesar de su tamaño más pequeño, demuestra capacidades excepcionales y promete superar en rendimiento a modelos más grandes de IA.

Este modelo, entrenado con datos de alta calidad, se destaca por su eficiencia y capacidad de aprendizaje, logrando un alto rendimiento sin técnicas de aprendizaje avanzadas y mostrando mejor comportamiento en términos de sesgos y toxicidad. El avance se reveló por primera vez durante el evento Ignite 2023 de Microsoft, en el que el CEO Satya Nadella brindó algunos detalles.

Phi-2 supera a otros modelos de lenguajes pequeños existentes, pero es lo suficientemente pequeño como para ejecutarse en una computadora portátil o un dispositivo móvil.

A diferencia de GPT y otros modelos de lenguajes grandes (LLM), un SLM se entrena en un conjunto de datos limitado, utiliza menos parámetros pero también requiere menos cálculos para ejecutarse. Como resultado, el modelo que no puede generalizarse tanto como un LLM pero que puede ser muy bueno y eficiente en tareas específicas, como matemáticas y cálculos.

Phi-2 supera a grandes, incluida la IA de Google

Phi-2 ha mostrado desempeño sobresaliente en pruebas de referencia complejas, evaluando sus habilidades de razonamiento, comprensión del lenguaje, matemáticas, codificación y sentido común. Este modelo es notable por superar el rendimiento de modelos mucho más grandes y establecidos, incluyendo Mistral de 7.000 millones de parámetros y Llama 2 de Meta de 13 mil millones parámetros, y en algunos casos, incluso supera a Gemini Nano de Google, que es el modelo más eficiente dentro de la recién anunciada serie Gemini.

Una característica interesante de Phi-2 es que, a diferencia de modelos de lenguaje más grandes, fue entrenado con lo que Microsoft denomina “datos de calidad de libro de texto“, enfocados específicamente en conocimiento, razonamiento y sentido común. Esto permite que Phi-2 aprenda más a partir de una menor cantidad de información. Además, Microsoft implementó técnicas que permiten la incorporación de conocimientos de modelos más pequeños.

Phi-2 ha logrado un rendimiento sólido sin utilizar técnicas como el aprendizaje reforzado basado en retroalimentación humana o la afinación instructiva, que a menudo se emplean para mejorar el comportamiento de los modelos de IA. A pesar de no utilizar estas técnicas, Phi-2 demostró un rendimiento superior en términos de mitigar sesgos y toxicidad en comparación con otros modelos de código abierto que sí los utilizan. Microsoft atribuye esto a su técnica de curación de datos a medida.

Phi-2 es el más reciente lanzamiento en una serie de lo que los investigadores denominan “modelos de lenguaje pequeños” o SML. El primero, Phi-1, se lanzó a principios de este año con 1,3 mil millones de parámetros, habiendo sido afinado para tareas básicas de codificación en Python. En septiembre, la empresa lanzó Phi-1.5, con 1,3 mil millones de parámetros, entrenado con nuevas fuentes de datos que incluían varios textos sintéticos generados con programación en lenguaje natural.

La eficiencia de Phi-2 lo convierte en una plataforma ideal para investigadores que deseen explorar áreas como la mejora de la seguridad de la IA, la interpretabilidad y el desarrollo ético de modelos de lenguaje.